이번 포스팅에서 다루고자 하는 주제는 “robots.txt”입니다. 이 용어가 낯설게 느껴질 수 있는데요, 검색 엔진 최적화에서 절대 빼놓을 수 없는 요소인 만큼 이해해야 합니다.

1. robots.txt란?

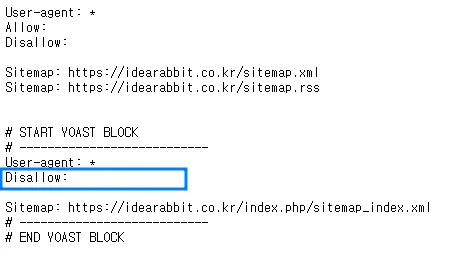

크롤러가 사이트의 섹션에 액세스하지 못하도록 하려면 적절한 규칙으로 robots.txt 파일을 만들면 됩니다. robots.txt 파일은 어떤 크롤러가 사이트의 어느 부분에 액세스할 수 있는지에 관한 규칙이 포함된 간단한 텍스트 파일입니다. 예를 들어, example.com의 robots.txt 파일은 다음과 같을 수 있습니다.

출처 : 구글 검색 센터

“robots.txt”라는 단어는 검색 엔진 최적화에 대해 알아보셨으면 한번 쯤은 들어 보셨을만한 단어입니다.웹 사이트를 운영하면서 알아야 하는 기본 중의 기본입니다. robots.txt는 웹 사이트의 루트 디렉토리에 위치한 텍스트 파일인데요, 이 파일은 웹 크롤러가 사이트를 방문했을 때 무엇을 수집해가도 되는지, 어떤 부분은 절대 건드리지 말아야 하는지를 알려주는 역할을 합니다.

그래서 이 robots.txt 파일은 사이트의 특정 영역을 검색 엔진의 크롤링으로부터 보호할 수 있게 도와주는 중요한 도구라고 볼 수 있습니다.

2. robots.txt를 적용 해야하는 이유??

“그럼 robots.txt를 왜 써야 하나요?”라고 물을 수도 있습니다. 그러나 우리의 사이트가 어떤 정보를 검색 엔진에게 제공하고, 어떤 정보는 숨길지를 제어하면서 우리의 웹사이트에 대한 검색 결과를 향상시키는 데 있어 중요한 역할을 합니다. 검색 엔진은 robots.txt가 제출 돼있는지 여부를 확인 후 검색 엔진 최적화에 가산점을 부여하기 때문이죠.

예를 들어, 회원 전용 페이지나 개인 정보와 같은 민감한 정보를 포함하는 페이지를 검색 엔진의 인덱싱 대상에서 제외하고 싶을 때, robots.txt를 통해 그런 페이지들을 ‘Disallow’로 설정하면 됩니다. 이렇게 해두면 크롤러들은 그런 페이지를 수집하지 않게 됩니다.

단, 검색 노출을 원하는 페이지에 허용 해놓지 않는 경우가 많아서 꼭 체크해보셔야합니다.

3. robots.txt 제출되어있는지 확인하는 방법??

쉽게 확인할 수 있는 방법이 있습니다. 웹 브라우저 주소창에 도메인/robots.txt’를 입력하면 robots.txt 파일의 내용을 확인할 수 있습니다.

예를 들어, ‘https://idearabbit.co.kr/robots.txt’라고 입력했을 때, 여러분의 robots.txt 파일이 제대로 열리면, 그것이 바로 제대로 설정되어 있다는 뜻입니다.

4. robots.txt를 업로드 하는 방법?

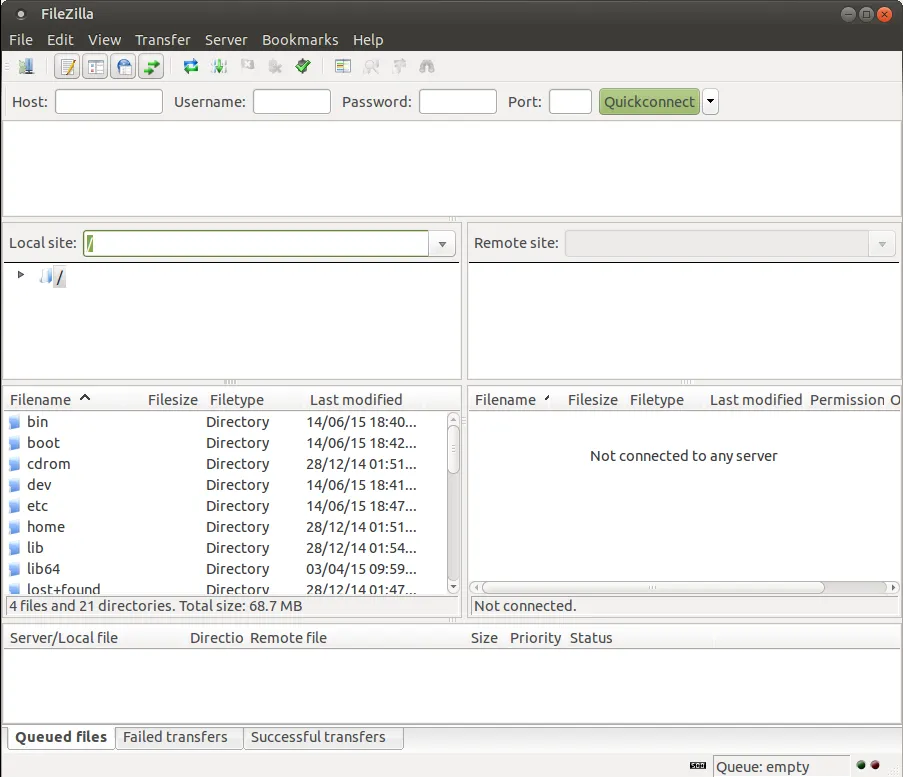

robots.txt가 제출 돼있지 않으면 업로드를 해야합니다. robots.txt 파일은 사이트의 루트 디렉토리에 위치해야 하며, 대개의 경우 웹 호스팅 서비스의 파일 관리자 (Cpanel) 또는 FTP를 통해 업로드할 수 있습니다.(어려울 경우 개발자의 도움을 받아보세요)

robots.txt 파일의 내용은 간단합니다. ‘User-agent’ 뒤에는 크롤러의 이름이 오고, ‘Disallow’ 뒤에는 크롤링을 막을 경로가 옵니다. 예를 들어, Googlebot(구글의 웹 크롤러)이 특정 페이지를 크롤링하지 못하게 하려면 다음과 같이 작성하면 됩니다.

javascriptCopy codeUser-agent: Googlebot

Disallow: /example-page/

(FTP 업로더 파일질라)

이런 식으로 작성한 robots.txt 파일을 웹 사이트의 루트 디렉토리에 업로드하면, 해당 크롤러는 지정된 경로를 크롤링하지 않습니다.

(크롤링을 원하지 않는 페이지에만 / 가 들어가야 합니다)

마지막으로 robots.txt는 사이트 운영자가 검색 엔진에 어떤 정보를 제공하고, 어떤 정보를 숨길지를 결정할 수 있는 강력한 도구입니다. 이것을 잘 활용하면 검색 결과에 더 좋은 영향을 미칠 수 있습니다. 이렇게 SEO에 대한 이해를 높이는 것은, 우리가 운영하는 사이트를 더 효과적으로 관리하고, SEO 마케팅을 하는데에 큰 도움이 될 것입니다.

긴 글 읽어주셔서 감사합니다 🙂

같이 읽으면 도움되는 글 : 구글 상위노출 10가지 방법, 1페이지에 랭크 되고 싶은 분만 보세요

초보자를 위한 사이트맵(sitemap.xml) 가이드 총정리